筑波大学附属駒場中学・高等学校(筑駒)で行われた本講義は、現代物理学の最重要テーマの一つである「情報と物理学」の関係性を解き明かす内容です。

講師のたくみ氏は、物理学を「少数の基本法則で多くの現象を説明する学問」と定義します。

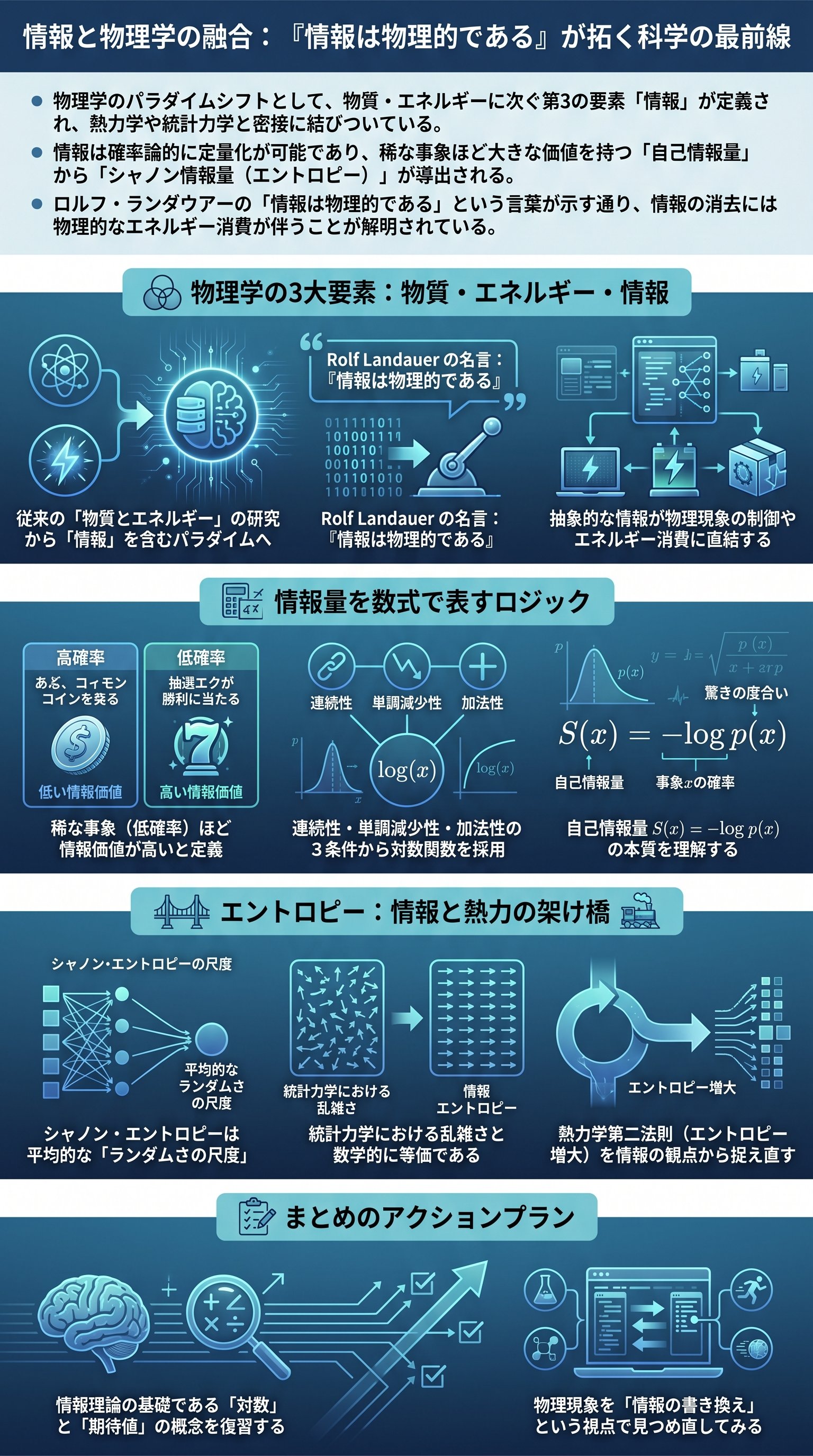

力学、電磁気学、熱力学といった伝統的な体系に加え、現代では「情報」が物質やエネルギーと並ぶ物理学の構成要素として定着しています。

物理学における情報の重要性を端的に示すのが、Rolf Landauer (ロルフ・ランダウアー) が提唱した「Information is physical (情報は物理的である)」という言葉です。

これは、情報の保持や操作が単なる抽象的なプロセスではなく、必ず物理的な実体とエネルギー消費を伴うことを意味しています。

この概念を理解するためには、まず「情報」を数学的に定量化する必要があります。

情報の定量化には「情報理論」が用いられます。

Claude Shannon (クロード・シャノン) が確立したこの理論では、情報の価値を「稀さ(確率の低さ)」で定義します。

例えば、滅多に起きない事象が起きた時、その情報量は大きくなります。

この直感を数理モデル化したものが「自己情報量」です。

自己情報量は、単調減少性、連続性、そして独立した事象の和で表せる「加法性」という3つの性質を満たす必要があります。

これらの条件を満たす関数を求めると、対数関数を用いた $S(x) = -\log p(x)$ という形式が導き出されます。

ここで $p(x)$ は事象 $x$ が起こる確率です。

負の符号がつくのは、確率が低いほど情報の値が大きくなることを保証するためです。

この自己情報量を、起こり得るすべての事象について平均(期待値)をとったものが「シャノン情報量」、あるいは「シャノン・エントロピー」と呼ばれます。

エントロピーという言葉は、元々は物理学の熱力学において「不可逆性」を示す指標として誕生しました。

熱力学第二法則によれば、断熱系においてエントロピーは減少することはありません。

一方、統計力学の視点では、エントロピーは「系の乱雑さ」や「状態の確かからしさ」を表します。

一見異なるこれらの分野が、情報の概念を通じて数式上で完全に一致したことは、科学史上極めて重要な発見でした。

講義内では、筑駒卒業生であり、現在は東京大学の准教授を務める白石直人氏とのエピソードも交えられました。

白石氏は「情報熱力学」の専門家であり、たくみ氏が大学院時代に薫陶を受けた人物です。

物理ジョークとして「時間の進まないカレンダー」の話が紹介されましたが、これは物理学者がいかに情報の記録(時間発展)に対して独自の感性を持っているかを物語っています。

講義の聴講生が「169人(13の平方数)」であったことに触れ、筑駒生の知的好奇心の高さを称えつつ、数学的な厳密さと物理的な直感を繋ぐプロセスが解説されました。

数式アレルギーを持つ学生に対しても、対数(log)の性質が情報の加法性を支えているという本質を伝えることで、抽象的な理論を身近なものへと落とし込んでいます。

特に「量子力学」と情報の相性の良さについても言及されました。

ミクロの世界では物理量が確率的にしか表現できないため、情報の言葉で物理現象を記述することが不可欠になります。

現代では、量子コンピュータや量子通信といった分野で、この「情報と物理の融合」が実用化のフェーズに入っています。

最後に、たくみ氏は熱力学が高校物理では不人気である現状を嘆きつつも、その背後にある情報理論との繋がりを知ることで、学問の深みと面白さを再発見してほしいと締めくくりました。

情報は単なるビットの羅列ではなく、宇宙を構成する物理的な実体そのものである。

この視点を持つことで、物理学の全容がより統一的に見えてくるはずです。