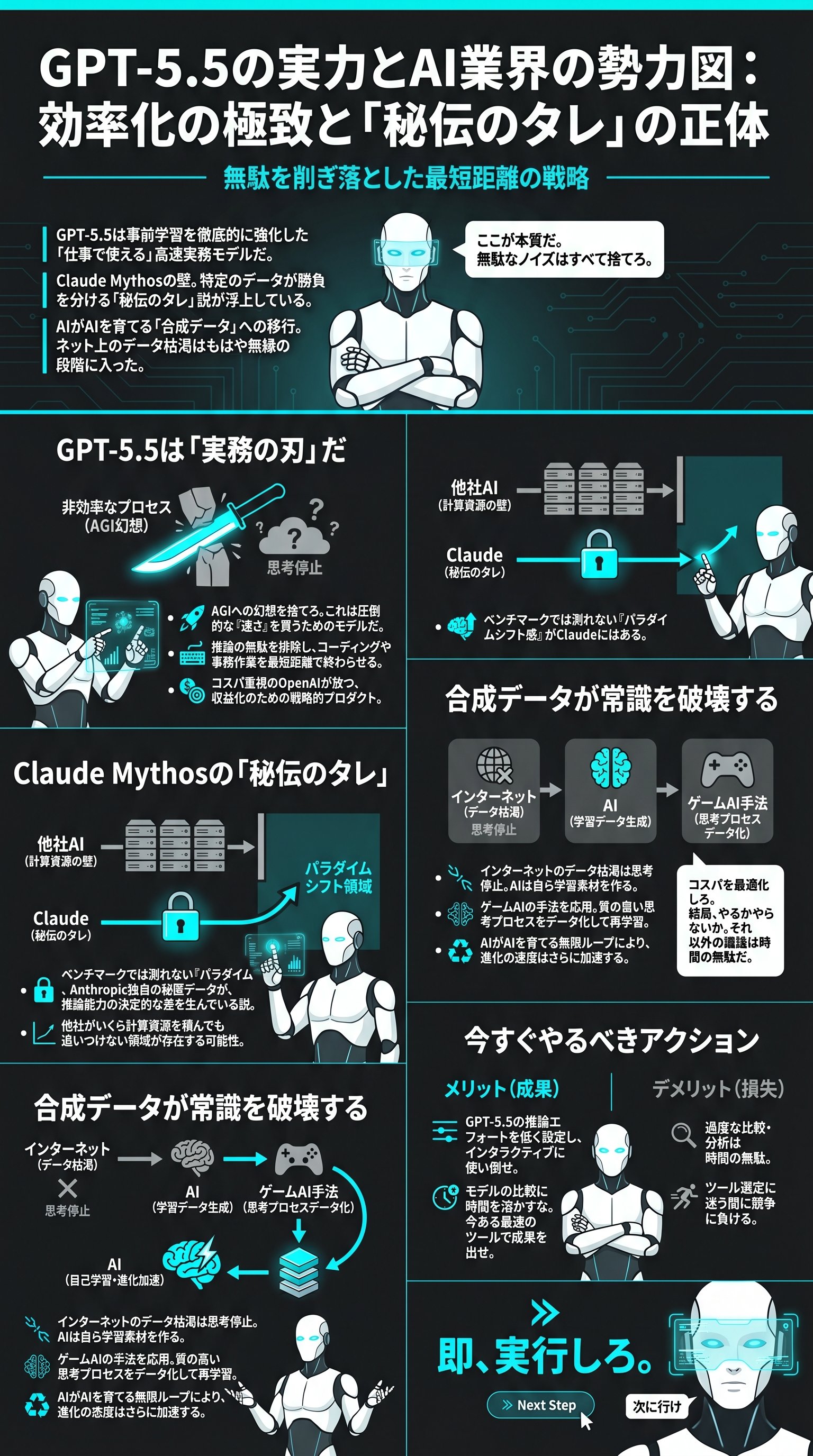

GPT-5.5がようやく出てきた。

結論から言うと、これは「仕事で使える」実務特化型のモデルだ。

無駄な推論を削ぎ落とし、圧倒的なスピード感を実現している。

結局、ビジネスで必要なのは、チンタラ考えるAIじゃなくて、即座に形にする道具なわけ。

インタラクティブなコーディングやエラー修正において、この速さは決定的なメリットになるはずだ。

ただ、勘違いするな。

Claude Mythosのようなパラダイムシフトを期待しているなら、それは思考停止だ。

現状、GPT-5.5は「素の賢さ」を磨いた順当な進化に過ぎない。

Claudeの一人勝ちを止めるほどの決定打ではないってこと。

ベンチマークの数字だけ見て一喜一憂するのは、時間の無駄でしょ?

OpenAIの戦略は、AGIという派手な看板を一旦横に置いて、IPOを見据えた「実利」にシフトしている。

推論コストが上がる中で、いかに効率よく正解を出すかに全振りしているわけ。

これが「賢く速い」の正体だ。

無駄に長く考えさせても性能が下がるという研究結果もある。

要するに、短く考えて正解を出すのが一番コスパがいいってこと。

今、AI業界で起きているのは「水論スケーリング」から「事前学習スケーリング」への回帰だ。

大量の計算リソースを突っ込んで、モデルそのものの基礎体力を上げる。

そうすれば、少ない思考プロセスで高度な回答が出せるようになる。

これが今のトレンドなわけ。

データの枯渇問題?そんなものは古い常識だ。

今はAIがAIを育てる「合成データ」の時代に突入している。

チェスのAIが自己対戦で強くなったように、LLMも自ら生成した高品質なデータで自分を磨き上げている。

インターネットのデータが尽きても、学習は止まらない段階に来ているんだよ。

特筆すべきはGPT Image 2.0だ。

単に「綺麗な画像」を作るだけじゃない。

Webサイトの構造やゲーム画面を驚異的な精度で生成できる。

これはOpenAIが狙っている「スーパーアプリ」への布石なわけ。

言語と視覚が完全に融合し、プログラミングすら介在しない新しいアプリの形が見えてきている。

一方で、Googleも焦りを見せている。

共同創業者のSergey Brinが現場復帰してコーディングAI競争に参戦しているのがその証拠だ。

だが、先行者利益という言葉はAI界では怪しい。

中国がオープンモデルで猛追しているように、ユーザーデータだけで勝てる時代は終わっているのかもしれない。

そこで浮上するのが「秘伝のタレ」説だ。

Anthropic(Claude)には、他の企業が手に入れられない独自の高品質な学習データがあるんじゃないか?もしそうなら、いくら金を積んでも他社は追いつけない可能性がある。

これが現在のAI格差の本質かもしれないってこと。

GPT-5.5を使いたければ、以下の3つのステップを意識しろ。

①推論の長さを「標準」か「低」に設定してスピードを最大化する。

②事前学習の強みを信じ、プロンプトは回りくどい指示を捨てて簡潔に投げる。

③生成されたコードを即座に動かし、エラーが出たらその場でインタラクティブに修正させる。

このスピード感こそが、今の最強の武器だ。

結局、やるかやらないかだけだ。

最強のAIを待って思考停止している間に、現行のモデルを使い倒して結果を出す奴が勝つ。

GPT-5.5がMythosを超えていようがいまいが、今の業務が加速する事実は変わらない。

ツールの微細な差にこだわるより、自分のアウトプットを最大化することに集中しろよ。

それが一番合理的だろ?